Социально-экономическая статистика

Статистическое изучение взаимосвязи социально — экономических явлений

Исследование объективно существующих связей между явлениями — важнейшая задача общей теории статистики. В процессе статистического исследования зависимостей вскрываются причинно - следственные отношения между явлениями, что позволяет выявлять факторы (признаки), оказывающие основное влияние на вариацию изучаемых явлений и процессов. Причинно-следственные отношения — это связь явлений и процессов, когда изменение одного из них — причины, ведет к изменению другого — следствия.

Особое значение при исследовании причинно-следственных связей имеет выявление временной последовательности: причина всегда должна предшествовать следствию, однако не каждое предшествующее событие следует считать причиной, а последующее — следствием.

В реальной социально-экономической действительности причину и следствие необходимо рассматривать как смежные явления, появление которых обусловлено комплексом сопутствующих более простых причин и следствий. Между сложными группами причин и следствий возможны многозначные связи, когда за одной причиной будет следовать то одно, то другое действие или одно действие имеет несколько различных причин. Каждое явление может выступать в одних случаях как причина, а в других — как следствие.

Но чем сложнее изучаемые явления, тем труднее выявить причинно-следственные связи между ними. Взаимное переплетение различных внутренних и внешних факторов неизбежно приводит к некоторым ошибкам в определении причины и следствия. Социально-экономические явления представляют собой результат одновременного воздействия большого числа причин. Поэтому при изучении этих явлений необходимо выявлять главные, основные причины, абстрагируясь от второстепенных.

На первом этапе статистического изучения связи проводят качественный анализ изучаемого явления, связанный с анализом

природы социального или экономического явления при помощи экономической теории, социологии, конкретной экономики. Второй этап — построение модели связи. Он базируется на методах статистики: группировках, средних величинах, таблицах и т. д. Третий, последний этап — интерпретация результатов — вновь связан с качественными особенностями изучаемого явления.

Статистика разработала множество методов изучения связей, выбор которых зависит от целей исследования и поставленных задач. Признаки по их значению для изучения взаимосвязи делятся на два класса. Признаки, обусловливающие изменения других, связанных с ними признаков, называются факторными или просто факторами. Признаки, изменяющиеся под действием факторных признаков, являются результативными.

Связи между явлениями и их признаками классифицируются по степени тесноты связи, направлению и аналитическому выражению.

В статистике различают функциональную связь и статистическую зависимость. Функциональной называют такую связь, при которой определенному значению факторного признака соответствует одно значение результативного признака. Функциональная связь проявляется во всех случаях наблюдения и для каждой единицы исследуемой совокупности.

Если причинная зависимость проявляется не в каждом отдельном случае, а в общем, среднем при большом числе наблюдений, то такая зависимость называется статистической. Частным случаем связи является корреляционная связь, при которой изменение среднего значения результативного признака обусловлено изменением факторных признаков.

По степени тесноты связи различают следующие количественные критерии оценки тесноты связи.

|

Количественные критерии оценки тесноты связи

|

По направлению выделяют связь прямую и обратную. При прямой связи с увеличением или уменьшением значении факторного признака происходит увеличение или уменьшение значений результативного. Так, рост производительности труда способствует увеличению уровня рентабельности производства. В случае обратной связи значения результативного признака изменяются под воздействием факторного, но в противоположном направлении по сравнению с изменением последнего. Так, с увеличением уровня фондоотдачи снижается себестоимость единицы производимой продукции.

По аналитическому выражению выделяют связи прямолинейные (или просто линейные) и криволинейные (нелинейные). Если статистическая связь между явлениями может быть приближенно выражена уравнением прямой линии, то ее называют линейной связью; если же она выражается уравнением какой-либо кривой линии (параболы, гиперболы, степенной, показательной, экспоненциальной и т. д.), то такую связь называют нелинейной или криволинейной.

Для выявления наличия связи, ее характера и направления в статистике используются следующие методы: анализ параллельных рядов; аналитические группировки; графический метод; метод корреляции.

Метод приведения параллельных данных основан на сопоставлении двух или нескольких радов статистических величин. Такое сопоставление позволяет установить наличие связи и получить представление о ее характере. Сравним изменения возраста и веса ребенка.

|

Возраст (лет) |

1 |

2 |

3 |

4 |

5 |

6 |

7 |

|

Вес (кг) |

3,2 |

5,3 |

8,0 |

12 |

16.5 |

20,8 |

25 |

С увеличением возраста вес ребенка также увеличивается. Поэтому связь между ними прямая, и описать ее можно или уравнением прямой, или уравнением параболы второго порядка.

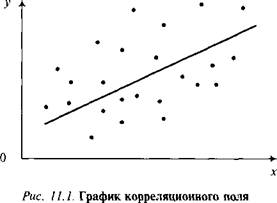

Графически взаимосвязь двух признаков изображается с помощью поля корреляции. В системе координат на оси абсцисс откладываются значения факторного признака, а на оси ординат — результативного. Каждое пересечение линий, проводимых через эти оси, обозначается точкой. При отсутствии тесных связей имеет место беспорядочное расположение точек на графике (рис. 11.1).

|

|

|

Чем сильнее связь между признаками, тем теснее будут группироваться точки вокруг определенной линии, выражающей форму связи. |

Для социально-экономических явлений характерно, что наряду с существенными факторами, формирующими уровень результативного признака, на него оказывают воздействие многие другие неучтенные и случайные факторы. Это свидетельствует о том, что взаимосвязи явлений, которые изучает статистика, носят корреляционный характер.

Корреляция — это статистическая зависимость между случайными величинами, не имеющими строго функционального характера, при которой изменение одной из них приводит к изменению математического ожидания другой.

В статистике принято различать следующие варианты зависимостей.

1. Парная корреляция — связь между двумя признаками (результативным и факторным).

2. Частная корреляция — зависимость между результативным и одним из факторных признаков при фиксированном значении других факторных признаков.

3. Множественная корреляция — зависимость результативного и двух или более факторных признаков, включенных в исследование.

Корреляционный анализ имеет своей задачей количественное определение тесноты связи между двумя признаками (при парной связи) и между результативным и множеством факторных при

знаков (при многофакторной связи). Теснота связи количественно выражается величиной коэффициентов корреляции. Коэффициенты корреляции, представляя количественную характеристику тесноты связи между признаками, дают возможность определять «полезность» факторных признаков при построении уравнений множественной регрессии. Величина коэффициента корреляции служит также оценкой соответствия уравнения регрессии выявленным причинно-следственным связям,

Одновременно с корреляцией начата использоваться и регрессия. Корреляция и регрессия тесно связаны между собой: первая оценивает силу (тесноту) статистической связи, вторая исследует ее форму. Обе служат для определения наличия или отсутствия связи между явлениями.

Регрессионный анализ заключается в определении аналитического выражения связи, в котором изменение одной величины (называемой зависимой, или результативным признаком) обусловлено влиянием одной или нескольких независимых величин (факторов), а множество всех прочих факторов, также оказывающих влияние на зависимую величину, принимается за постоянные и средние значения. Регрессия может быть однофакторной (парной) и многофакторной (множественной).

По форме зависимости различают:

а) линейную регрессию, которая выражается уравнением прямой (линейной функцией) вида:

Y=aQ+a{x

б) нелинейную регрессию, которая рассчитывается уравнением вида:

парабола: Y= а,} + а, х + а7 х1;

гипербола: Уу = а0 + — и т. д.

X

По направлению связи различают:

а) прямую регрессию (положительную), возникающую при условии, если с увеличением или уменьшением независимой величины значения зависимой также соответственно увеличиваются или уменьшаются;

б) обратную регрессию (отрицательную), появляющуюся при условии, что с увеличением или уменьшением независимой величины зависимая, наоборот, уменьшается или увеличивается.

При использовании корреляционно-регрессионного анализа необходимо соблюдать следующие требования.

1. Совокупность исследуемых исходных данных должна быть однородной и математически описываться непрерывными функциями.

2. Все факторные признаки должны иметь количественное (цифровое) выражение.

3. Необходимо наличие достаточно большого объема исследуемой выборочной совокупности.

4. Причинно-следственные связи между явлениями и процессами могут быть описаны линейной или приводимой к линейной формой зависимости.

5. Не должно быть количественных ограничений на параметры модели связи.

6. Необходимо обеспечить постоянство территориальной и временной структур изучаемой совокупности.

Соблюдение данных требований позволяет исследователю построить статистическую модель связи, наилучшим образом аппроксимирующую моделируемые социально-экономические явления и процессы.

Теоретическая обоснованность моделей взаимосвязи, построенных на основе корреляционно-регрессионного анализа, обеспечивается соблюдением следующих основных условий.

1. Все признаки и их совместные распределения должны подчиняться нормальному закону распределения.

2. Дисперсия моделируемого признака должна оставаться постоянной при изменении величины значений факторных признаков.

3. Отдельные наблюдения должны быть независимыми, т. е. результаты, полученные в /-м наблюдении, не должны быть связаны с предыдущими и содержать информацию о последующих наблюдениях, а также влиять на них.

Отступление от выполнения этих условий и предпосылок приводит к тому, что параметры регрессии не будут отражать реальное воздействие на моделируемый показатель.

Одной из проблем построения уравнения регрессии является размерность параметров, т. е. определение числа факторных признаков, включаемых в модель. Их число должно быть оптимальным. Сокращение размерности за счет исключения второстепенных, несущественных факторов позволяет получить модель, быстрее и качественнее реализуемую. В то же время построение модели малой размерности может привести к тому, что она будет недостаточно полно описывать исследуемое явление или процесс в единой системе национального счетоводства. При построении модели число факторных признаков должно быть в 5—6 раз меньше объема изучаемой совокупности.

Парная регрессия характеризует связь между двумя признаками: результативным и факторным. Аналитически связь между ними описывается уравнениями:

• прямой: Ух = а() + а{х

• гиперболы: ух = а0 + — ;

X

• параболы: Yx = а0 + ахх + а2х2 и т. д.

Выбор типа уравнения зависит от исследователя. В частности, если результативный и факторный признаки возрастают примерно в арифметической прогрессии, то это свидетельствует о том, что связь между ними линейная, а при обратной связи — гиперболическая. Если результативный признак увеличивается в арифметической прогрессии, а факторный — значительно быстрее, то используется параболическая или степенная регрессия.

Оценка параметров уравнений регрессии (я0, а,, и а2 — в уравнении параболы второго порядка) осуществляется методом наименьших квадратов, в основе которого лежит предположение о независимости наблюдений исследуемой совокупности.

Система нормальных уравнений для нахождения параметров линейной парной регрессии методом наименьших квадратов имеет следующий вид:

[пао + а^х^у [ао^х+а^х2 =^ху,

где п — объем исследуемой совокупности (число единиц наблюдений).

В уравнениях регрессии параметр а0 показывает усредненное влияние на результативный признак неучтенных (не выделенных для исследования) факторов; параметр ах (в уравнении параболы а і и а2) — насколько изменяется в среднем значение результативного признака при увеличении факторного на единицу собственного измерения.

Если связь между признаками У и X криволинейная и описывается уравнением параболы второго порядка, то

а 2

Ух = а^+а{Х+аіХ •

В данном случае задача сводится к определению неизвестных параметров: а0 а{ а2. Они определяются на основе системы нормальных уравнений

я0 ■ X*2 + а, • X*3 + а2 ■ = ]Г vx2.

Решая систему и определив значения неизвестных коэффициентов й0 л, а,, мы получим искомое уравнение регрессии.

Оценка обратной зависимости между X и Y, когда с увеличением (уменьшением) X уменьшается (увеличивается) значение результативного признака Y, должна быть осуществлена на основе уравнения гиперболы

.Y

Систему нормальных уравнений для нахождения параметров гиперболы можно представить следующим образом:

х

^ X ^ х~ X

Применение метода наименьших квадратов объясняется неизбежным наличием случайных ошибок в результатах опыта. Статистические данные могут иметь ошибки, возникающие вследствие-.

• неполноты охвата единиц, поскольку часть единиц совокупности, полученных в результате наблюдения, не может быть использована в исследовании;

• неполноты охвата факторов, определяющих то или иное социально-экономическое явление, в силу того что ни в одно уравнение или модель нельзя включить бесконечное число аргументов (во всех случаях отбирается только часть факторов, причем отбор носит чисто субъективный характер);

• характера выбранного уравнения связи. Как бы хорошо оно ни было обосновано, как бы теоретически адекватно ни описывало исследуемое явление, оно не может быть его точным аналогом.

Изучение связи между тремя и более связанными между собой признаками носит название множественной (многофакторной) регрессии. При исследовании зависимостей методами множественной регрессии требуется определить аналитическое выражение связи между результативным признаком (Y) и факторными признаками (Х{, Х2, Х3,.-.., Хк), т. е. найти функцию:

Yx=f(Xt, Х2,..., XJ.

Построение моделей множественной реірессии включает несколько этапов:

• выбор формы связи (уравнения регрессии);

• отбор факторных признаков;

• обеспечение достаточного объема совокупности для получения несмещенных оценок.

Рассмотрим подробнее каждый из них.

Выбор формы связи затрудняется тем, что теоретически зависимость между признаками может быть выражена большим числом различных функций, что затрудняет использование математического аппарата.

Выбор типа уравнения осложнен тем, что для любой формы зависимости выбирается целый ряд уравнений, которые в определенной степени будут описывать эти связи,

Поскольку уравнение регрессии строится главным образом для объяснения и количественного выражения взаимосвязей, оно должно хорошо отражать сложившиеся между исследуемыми факторами фактические связи.

Практика построения многофакторных моделей взаимосвязи показывает, что все реально существующие зависимости между социально-экономическими явлениями можно описать, используя пять типов моделей:

1) линейная: ^ 2 к = ао + ах + а2х2 +--+ ал;

2) параболическая: 3>і 2,. к = ао + ах2 + а2хг +--+ аЛ2^

Л fll а, ау

3) гиперболическая: у12 к=ао+—і - —+ ...Н ;

X] х2 хк

4) степенная: >>| 2 к = аохial ‘ х2а2+...+хКак;

5) показательная: к =ila"id<'<+

Основное значение имеют линейные модели в силу простоты и логичности их экономической интерпретации. Нелинейные формы зависимости приводятся к линейным путем линеаризации.

Важным этапом построения уже выбранного уравнения множественной регрессии является отбор и последующее включение факторных признаков.

Сложность формирования уравнения множественной регрессии заключается в том, что почти все факторные признаки находятся в зависимости один от другого.

Проблема размерности модели связи, т. е. определение оптимального числа факторных признаков, — одна из основных проблем построения множественного уравнения регрессии. С одной стороны, чем больше факторных признаков включено в уравнение, тем оно лучше описывает явление. С другой стороны, сокращение размерности модели за счет исключения второстепенных, экономически и статистически несущественных факторов способствует простоте и качеству ее реализации.

Проблема отбора факторных признаков для построения моделей взаимосвязи может быть решена с помощью эвристических или многомерных статистических методов анализа. Наиболее приемлемым методом отбора факторных признаков является шаговая регрессия (шаговый регрессионный анализ). Сущность данного метода заключается в последовательном включении факторов в уравнение регрессии и последующей проверке их значимости. Факторы поочередно вводятся в уравнение так называемым «прямым методом». При проверке значимости введенного фактора определяется, насколько уменьшается сумма квадратов остатков и увеличивается величина множественного коэффициента корреляции (R). Одновременно используется и обратный метод, т. е. исключение факторов, ставших незначимыми на основе /-критерия Стьюдента. Фактор является незначимым, если его включение в уравнение регрессии только изменяет значение коэффициентов регрессии, не уменьшая суммы квадратов остатков и не увеличивая их значения. Если при включении в модель соответствующего факторного признака величина множественного коэффициента корреляции увеличивается, а коэффициент регрессии не изменяется (или меняется несущественно), то данный признак существен и его включение в уравнение регрессии необходимо.

Сложность и взаимное переплетение отдельных факторов, обусловливающих исследуемое экономическое явление (процесс), могут проявляться в так называемой мультиколлинеарности, под которой понимается тесная зависимость между факторными признаками, включенными в модель.

Наличие мультиколлинеарности между признаками приводит к: • искажению величины параметров модели;

• изменению смысла экономической интерпретации коэффициентов регрессии;

• слабой обусловленности системы нормальных уравнений;

• осложнению процесса определения наиболее существенных факторных признаков.

В решении проблемы мультиколлинеарности можно выделить несколько этапов:

• установление наличия мультиколлинеарности;

• определение причин возникновения мультиколлинеарности;

• разработка мер по ее устранению.

Мультиколлинеарность между признаками возникает, если:

1) изучаемые факторные признаки характеризуют одну и ту же сторону явления или процесса (например, показатели объема производимой продукции и производительность труда одновременно включать в модель не рекомендуется, так как производительность труда в числителе содержит показатель объема произведенной продукции);

2) в качестве факторных признаков используются показатели, суммарное значение которых представляет собой постоянную величину;

3) факторные признаки являются составными элементами друг друга (трудовые ресурсы и занятое население);

4) факторные признаки по экономическому смыслу дублируют друг друга.

Одним из индикаторов наличия мультиколлинеарности между признаками является превышение парным коэффициентом корреляции (rxjxj) между ними величины 0,8.

Устранение мультиколлинеарности может реализовываться путем исключения из корреляционной модели одного или нескольких линейно-связанных факторных признаков или введения в модель времени как независимой переменной.

Вопрос о том, какой из факторов следует отбросить, решается на основании качественного и логического анализов изучаемого явления.

Аналитическая форма выражения связи результативного признака и ряда факторных признаков называется многофакторным (множественным) уравнением регрессии, или моделью связи.

Уравнение линейной множественной регрессии имеет вид:

^,2 К= а0 +fl|*i+ а2х2 +-+аухк,

где Yj 2 к — теоретические значения результативного признака, по

лученные в результате подстановки соответствующих значений факторных признаков в уравнение регрессии;

Х х2,..., хк — факторные признаки;

а0, а|, ак — параметры модели (коэффициенты регрессии).

Для нахождения параметров линейной множественной регрессии необходимо решить систему уравнений:

Проверка адекватности моделей, построенных на основе уравнений регрессии, начинается с проверки значимости каждого коэффициента регрессии с помощью ґ-критерия Стьюдента:

|

|

где а2 — дисперсия коэффициента регрессии;

I а,| — /-й коэффициент регрессии по модулю.

Параметр модели признается статистически значимым, если tp > t (a, v= п — k— 1), т. е. наблюдаемое значение t больше его критического значения,

где а — уровень значимости критерия проверки гипотезы о равенстве нулю параметров, измеряющих связь, т. е. статистическая существенность связи утверждается при отклонении нулевой гипотезы об отсутствии СВЯЗИ,'

V=n — к — 1 — число степеней свободы, которое характеризует число свободно варьирующих элементов совокупности.

Наиболее сложным в этом выражении является определение дисперсии, которая может быть рассчитана двояким способом. Наиболее простой способ заключается в том, что величина дисперсии коэффициента регрессии может быть приближенно определена с помощью выражения:

где а 2 — дисперсия результативного признака; к — число факторных признаков в уравнении.

Наиболее сложным этапом, завершающим регрессионный анализ, является интерпретация уравнения, т. е. перевод его с языка статистики и математики на язык экономиста.

Интерпретация моделей регрессии осуществляется методами той отрасли знаний, к которой относятся исследуемые явления. Но всякая интерпретация начинается со статистической оценки уравнения регрессии в целом и оценки значимости входящих в модель факторных признаков, т. е. с выяснения, как они влияют на величину результативного признака. Чем больше величина коэффициента регрессии, тем значительнее влияние данного признака на моделируемый. Особое значение при этом имеет знак перед коэффициентом регрессии, который говорит о характере влияния на результативный признак. Если факторный признак имеет знак плюс, то с увеличением данного фактора результативный признак возрастает; если факторный признак имеет знак минус, то с его увеличением результативный признак уменьшается.

Интерпретация этих знаков полностью определяется социально-экономическим содержанием моделируемого (результативного) признака. Если его величина изменяется в сторону увеличения, то плюсовые знаки факторных признаков имеют положительное влияние. При изменении результативного признака в сторону снижения положительное значение имеют минусовые знаки факторных признаков. Если экономическая теория подсказывает, что факторный признак должен иметь положительное значение, а он является отрицательным, то необходимо проверить расчеты параметров уравнения регрессии. Такое явление чаще всего бывает в силу допущенных ошибок при решении. Однако следует иметь в виду, что при анализе совокупного влияния факторов, при наличии взаимосвязи между ними характер их влияния может меняться. Для того чтобы быть уверенным, что факторный признак изменил знак влияния, необходима тщательная проверка решения данной модели, так как часто знаки могут меняться в силу допустимых ошибок при сборе или обработке информации.

Построенная модель на основе ее проверки по /-критерию Фишера должна быть в целом адекватна и все ее коэффициенты регрессии значимы. Такая модель может быть использована для принятия решений к осуществлению прогнозов.

С целью расширения возможностей экономического анализа используются частные коэффициенты эластичности Эх,-, определяемые по формуле

о */ о *1

~аі ' - і 3, — аі' _ і

У У

где X/ — среднее значение соответствующего факторного признака;

у — среднее значение результативного признака;

а,- — коэффициент регрессии при соответствующем факторном признаке.

Коэффициент эластичности показывает, на сколько процентов в среднем изменится значение результативного признака с изменением факторного признака на 1%.

Частный коэффициент детерминации рассчитывается по формуле

где гт — парный коэффициент корреляции между результативным и /-м факторными признаками;

Рх. — соответствующий коэффициент уравнения множественной регрессии в стандартизованном масштабе.

Частный коэффициент детерминации показывает, на сколько процентов вариация результативного признака объясняется вариацией первого признака, входящего в множественное уравнение регрессии.

Множественный коэффициент детерминации (R2), представляющий собой множественный коэффициент корреляции в квадрате, показывает, какая доля вариации результативного признака обусловлена изменением факторных признаков, входящих в многофакторную регрессионную модель.

Измерение тесноты и направления связи является важной задачей изучения и количественного измерения взаимосвязи социально-экономических явлений. Оценка тесноты связи между признаками предполагает определение меры зависимости вариации результативного признака от одного (при изучении парных зависимостей) или нескольких (множественных) факторных признаков.

Линейный коэффициент корреляции был впервые введен в начале 90-х годов XIX в. Пирсоном, Эджвортом и Велдоном и характеризует тесноту и направление связи между двумя коррелируемыми признаками в случае наличия между ними линейной зависимости.

В теории разработаны и на практике применяются различные модификации формул расчета данного коэффициента:

<V°v <V°v '

Преобразования данной формулы позволяют получить следующую формулу линейного коэффициента корреляции:

£(*-*) (у-у) - х) ■ (у, - у)

Г——----------------------- ИЛИ г——Г ч = ,

°у - xf-(y-yf

где п — число наблюдений.

Между линейным коэффициентом корреляции и коэффициентом регрессии существует определенная зависимость, выражаемая формулой

где dj — коэффициент регрессии в уравнении связи;

<5Х. — среднеквадратическое отклонение соответствующего статистически существенного факторного признака.

Линейный коэффициент корреляции изменяется в пределах от —1 до +1. Знаки коэффициентов регрессии и корреляции совпадают. При этом интерпретацию значений коэффициента корреляции можно представить следующим образом.

|

Оценка линейного коэффициента корреляции

|

Значимость линейного коэффициента корреляции проверяется на основе /-критерия Стьюдента. При этом выдвигается и проверяется гипотеза (#0) о равенстве коэффициента корреляции нулю [Н. г = 0|. При проверке этой гипотезы используется /-статистика:

При выполнении гипотезы Н0 /-статистика имеет распределение Стьюдента с входными параметрами: (а1,к = п-2).

Если расчетное значение tp > tKp (табличное), то гипотеза Но отвергается, что свидетельствует о значимости линейного коэффициента корреляции, а следовательно, и о статистической существенности зависимости между X и У.

Среднеквадратическая ошибка линейного коэффициента корреляции определяется по формуле

|

|

При наличии зависимости между двумя признаками для измерения тесноты связи применяют так называемое корреляционное отношение. Различают эмпирическое и теоретическое корреляционные отношения.

Эмпирическое корреляционное отношение рассчитывается по данным группировки, когда S2 характеризует отклонения групповых средних результативного показателя от общей средней:

|

|

где г) — корреляционное отношение;

б2 — общая дисперсия результативного признака;

5^ — межірупповая дисперсия результативного признака.

|

|

|

где 52 — дисперсия выравненных значений результативного признака, т. е. рассчитанных по уравнению регрессии; о2 — дисперсия эмпирических (фактических) значений результатне- |

Теоретическое корреляционное отношение определяется по формуле

Корреляционное отношение изменяется в пределах от 0 до 1 (О = < л = < 1), и анализ степени тесноты связи полностью соответствует линейному коэффициенту корреляции. Оно характеризует долю вариации явления за счет группировочного признака в общей величине вариации явления за счет всех факторов (признаков).

Средняя квадратическая ошибка теоретического корреляционного отношения определяется из следующего выражения:

1-г

C,'~V^T ’

где N — объем изучаемой совокупности.

Значимость теоретического корреляционного отношения рассчитывается в том случае, если отношение г: аг больше или равно 3, т. е. вариация линейного коэффициента корреляции должна быть не более 1/3. Корреляционное отношение является более универсальным показателем тесноты связи по сравнению с линейным коэффициентом корреляции.

Для измерения тесноты связи при множественной корреляционной зависимости, т. е. при исследовании трех и более признаков одновременно, вычисляются множественный, или совокупный, и частные коэффициенты корреляции.

Множественный коэффициент корреляции рассчитывается при наличии линейной связи между результативным и несколькими факторными признаками, а также между каждой парой факторных признаков.

В случае оценки связи между результативным (у) и двумя факторными признаками (*,) и (х2) множественный коэффициент корреляции можно определить по формуле

+ 0*2 ~2гух

|

і |

1-ГІ

где г — парные коэффициенты корреляции между признаками.

Множественный коэффициент корреляции изменяется в пределах от 0 до 1 и по определению положителен: 0 = </?=< 1. Приближение R к единице свидетельствует о сильной зависимости между признаками.

Количественная оценка связей социальных явлений осуществляется на базе расчета и анализа рассмотренных выше коэффициентов.

Для оценки взаимосвязей качественных признаков статистика использует ряд коэффициентов, среди которых необходимо отметить следующие.

Коэффициент ассоциации и контингенции используется для определения тесноты связи двух качественных признаков, каждый из которых состоит только из двух групп. При исследовании связи данные располагают в виде таблицы сопряженности. Она показывает связь между двумя явлениями, каждое из которых должно быть альтернативным, т. е. состоящим из двух качественно отличных друг от друга значений признака. Например: а — работающие мужчины; b — неработающие мужчины; с — работающие женщины; d — неработающие женщины.

Таблица для вычисления коэффициентов ассоциации и контингенции

|

а |

b |

а + Ь |

|

с |

d |

с + d |

|

а + с |

b + d |

а + b + с + d |

Коэффициенты определяются по следующим формулам: коэффициент ассоциации:

Ка= (ad — be): (ad + bc) коэффициент контингенции:

К* = (ad — be) : у](а + b)(b + d)(a + с)(с + d).

Коэффициент контингенции всегда меньше коэффициента ассоциации. Связь считается подтвержденной, если Ка < 0,5 или К^. < 0,3.

Приблизительные оценки тесноты взаимосвязи между отдельными признаками можно измерять с помощью непараметрических коэффициентов связи. Для их расчета необходимо произвести ранжирование исходной информации. Ранжирование — это процедура упорядочения объектов изучения, которая выполняется на основе предпочтения. Ранг — порядковый номер значений признака, расположенных и порядке возрастания или убывания их величин. Если значения признака имеют одинаковую количественную оценку, то ранг всех этих значений принимается равным средней арифметической от соответствующих номеров мест, которые они занимают. Данные ранги называются связными.

Принцип нумерации значений исследуемых признаков является основой непараметрических методов изучения взаимосвязи между социально-экономическими явленнями и процессами. Среди непараметрических методов оценки тесноты связи наибольшее значение имеют ранговые коэффициенты Фехнера, Спирмена (р) и Кенделла (г). Эти коэффициенты могут быть использованы для определения тесноты связи как между количественными, так и между качественными признаками при условии, что их значения упорядочены или проранжированы по степени убывания или возрастания признака.

Коэффициент Фехнера определяется на основе соотношения знаков отклонений значений исследуемых признаков х и у от их средних величин. Он рассчитывается по формуле

_ а-Ь

Фе* . L. : а + Ь

где а — число совпадений отклонений (*, - х) и (г, - v) по знаку;

b — число несовпадений отклонений (х, - х) и (у, - у) по знаку;

(а+Ь) — общее количество значений признака.

Чем ближе величина коэффициента Фехнера к единице, тем теснее взаимосвязи между изучаемыми признаками.

Коэффициент корреляции рангов (коэффициент Спирмена) рассчитывается по формуле (для случая, когда нет связных рангов)

Рх/у п(п2-1)’

где d} — квадраты разности рангов (гх - гу)2

п — число наблюдений (число пар рангов).

Коэффициент Спирмена принимает любые значения в интервале от —1 до +1.

Ранговый коэффициент корреляции Кендалла (т) может также использоваться для измерения взаимосвязи между качественными и количественными признаками, характеризующими однородные объекты. Коэффициент рассчитывается по формуле

т =2S : п(п— 1),

где и — число наблюдений;

S — сумма разностей между числом последовательностей и числом инверсий по второму признаку.

Расчет данного коэффициента выполняется в следующей последовательности :

1) значения Аранжируются в порядке возрастания или убывания;

2) значения У располагаются в порядке, соответствующем значениям X;

3) для каждого ранга Y определяется число следующих за ним значений рангов, превышающих его величину. Суммируя таким образом числа, определяют величину Р как меру соответствия последовательностей рангов по X и Y и учитывают со знаком (+);

4) для каждого ранга Y определяется число следующих за ним рангов, меньших его по величине. Суммарная величина обозначается через Q и фиксируется со знаком (—);

5) определяется сумма баллов по всем членам ряда. Связь между признаками можно признать статистически значимой, если значения коэффициентов ранговой корреляции Спирмена и Кендалла больше 0,5.

Для определения тесноты связи между произвольным числом ранжированных признаков применяется множественный коэффициент ранговой корреляции (коэффициент конкордации) (W), который вычисляется по формуле

2/3 т (и - п)

где т — количество факторов;

« — число наблюдений,

S — отклонение суммы квадратов рангов от средней величины квадратов рангов.

Ранговые коэффициенты корреляции Фехнера, Спирмена, Кендалла и конкордации имеют то преимущество, что с помощью их можно измерять и оценивать связи как между количественными, так и между атрибутивными признаками, которые поддаются ранжированию.